Negli ultimi mesi mi è capitato più volte di osservare bambini giocare con l’intelligenza artificiale. Non in senso figurato: parlo proprio di bambini che usano strumenti di generative AI per disegnare, scrivere, chiedere consigli, creare mondi. Lo fanno con naturalezza, come se parlassero con un fratello maggiore digitale.

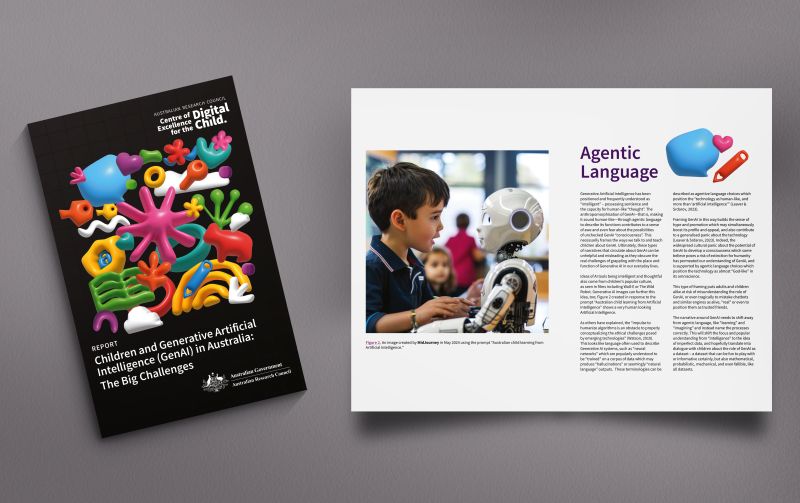

È in quei momenti che mi è tornato in mente un passaggio illuminante di un report dell’ARC Centre of Excellence for the Digital Child:

“Il problema non è che i bambini usino l’AI. Il problema è che spesso noi adulti non comprendiamo fino in fondo cosa ci sia davvero dietro questi strumenti.”

Perché possiamo anche raccontarci che l’intelligenza artificiale è un “assistente”, un “tool di produttività”, un supporto per la creatività. Ma la verità è che – nei fatti – iniziamo già a trattarla come un’entità intelligente. E i bambini lo capiscono al volo.

Se un chatbot ti ascolta, risponde, ti ricorda le cose e ti fa compagnia... come si può spiegare che “non è reale”? Dove finisce il gioco, e dove inizia la relazione?

Il linguaggio che plasma l’immaginario

Leaver e Srdarov, autori del report, introducono un concetto decisivo: agentic language. È il modo in cui parliamo dell’AI come se fosse viva, senziente, autonoma. Un linguaggio che non è affatto neutro: lo troviamo nei pitch delle big tech, nelle pubblicità, nelle serie TV, nei titoli dei giornali. E così, piano piano, finisce per colonizzare anche il nostro modo di pensare.

Nel frattempo, l’AI diventa ubiqua: nei giocattoli connessi, nei motori di ricerca, nelle piattaforme educative, nei social. Invisibile, ma potentissima. Semplice da usare, ma complessa da capire.

Ed è proprio questo il punto: l’intelligenza artificiale non capisce. Non sa. Non ha coscienza. È un sistema di probabilità, una macchina di approssimazioni statistiche, un generatore di plausibilità. Non pensa. Ma ci parla. E questo basta a farci abbassare la guardia.

Il vero rischio: come la rappresentiamo

Il report è straordinariamente lucido nel sottolineare una cosa:

“Il pericolo non è tanto l’AI, ma il modo in cui scegliamo di rappresentarla. Soprattutto a chi non ha ancora gli strumenti per distinguere tra simulazione e realtà.”

Per questo oggi più che mai serve una nuova alfabetizzazione. Non solo “AI literacy”, cioè saper scrivere prompt efficaci o usare strumenti di generative AI. Ma una critical AI literacy: la capacità di interrogare i limiti, i bias, l’impatto ambientale, le logiche opache e le disuguaglianze che l’AI porta con sé.

Una forma di consapevolezza diffusa. Non solo nei bambini, ma anche in noi adulti: insegnanti, genitori, designer, comunicatori, imprenditori, innovatori. Perché ogni volta che progettiamo un contenuto o un’esperienza usando l’intelligenza artificiale, stiamo contribuendo a costruire un immaginario.

Un ponte tra generazioni

L’AI non è (più) solo una tecnologia. È diventata un linguaggio culturale. E come ogni linguaggio, ha il potere di ridefinire i confini di ciò che è narrabile, visibile, credibile.

Per questo ogni gesto progettuale – ogni sito, app, video, chatbot, gioco – è un piccolo ponte tra presente e futuro, tra generazioni diverse.

La domanda che ci dobbiamo fare è semplice, ma decisiva:

Vogliamo attraversarlo con consapevolezza… o lasciare che siano le scorciatoie a scrivere il nostro futuro?

📖 Qui il report completo, per chi vuole approfondire: www.digitalchild.org.au/artificialintelligence

È in quei momenti che mi è tornato in mente un passaggio illuminante di un report dell’ARC Centre of Excellence for the Digital Child:

“Il problema non è che i bambini usino l’AI. Il problema è che spesso noi adulti non comprendiamo fino in fondo cosa ci sia davvero dietro questi strumenti.”

Perché possiamo anche raccontarci che l’intelligenza artificiale è un “assistente”, un “tool di produttività”, un supporto per la creatività. Ma la verità è che – nei fatti – iniziamo già a trattarla come un’entità intelligente. E i bambini lo capiscono al volo.

Se un chatbot ti ascolta, risponde, ti ricorda le cose e ti fa compagnia... come si può spiegare che “non è reale”? Dove finisce il gioco, e dove inizia la relazione?

Il linguaggio che plasma l’immaginario

Leaver e Srdarov, autori del report, introducono un concetto decisivo: agentic language. È il modo in cui parliamo dell’AI come se fosse viva, senziente, autonoma. Un linguaggio che non è affatto neutro: lo troviamo nei pitch delle big tech, nelle pubblicità, nelle serie TV, nei titoli dei giornali. E così, piano piano, finisce per colonizzare anche il nostro modo di pensare.

Nel frattempo, l’AI diventa ubiqua: nei giocattoli connessi, nei motori di ricerca, nelle piattaforme educative, nei social. Invisibile, ma potentissima. Semplice da usare, ma complessa da capire.

Ed è proprio questo il punto: l’intelligenza artificiale non capisce. Non sa. Non ha coscienza. È un sistema di probabilità, una macchina di approssimazioni statistiche, un generatore di plausibilità. Non pensa. Ma ci parla. E questo basta a farci abbassare la guardia.

Il vero rischio: come la rappresentiamo

Il report è straordinariamente lucido nel sottolineare una cosa:

“Il pericolo non è tanto l’AI, ma il modo in cui scegliamo di rappresentarla. Soprattutto a chi non ha ancora gli strumenti per distinguere tra simulazione e realtà.”

Per questo oggi più che mai serve una nuova alfabetizzazione. Non solo “AI literacy”, cioè saper scrivere prompt efficaci o usare strumenti di generative AI. Ma una critical AI literacy: la capacità di interrogare i limiti, i bias, l’impatto ambientale, le logiche opache e le disuguaglianze che l’AI porta con sé.

Una forma di consapevolezza diffusa. Non solo nei bambini, ma anche in noi adulti: insegnanti, genitori, designer, comunicatori, imprenditori, innovatori. Perché ogni volta che progettiamo un contenuto o un’esperienza usando l’intelligenza artificiale, stiamo contribuendo a costruire un immaginario.

Un ponte tra generazioni

L’AI non è (più) solo una tecnologia. È diventata un linguaggio culturale. E come ogni linguaggio, ha il potere di ridefinire i confini di ciò che è narrabile, visibile, credibile.

Per questo ogni gesto progettuale – ogni sito, app, video, chatbot, gioco – è un piccolo ponte tra presente e futuro, tra generazioni diverse.

La domanda che ci dobbiamo fare è semplice, ma decisiva:

Vogliamo attraversarlo con consapevolezza… o lasciare che siano le scorciatoie a scrivere il nostro futuro?

📖 Qui il report completo, per chi vuole approfondire: www.digitalchild.org.au/artificialintelligence